ChatGPT يتجاوز اختبار الكابتشا

ChatGPT يجتاز اختبار "أنا لست روبوتا" ويثير ذعر خبراء الأمن السيبراني!

أثارت ميزة "ChatGPT Agent" (ميزة جديدة في ChatGPT بقدرات الذكاء الاصطناعي الوكيل) مخاوف متزايدة بين خبراء الأمن السيبراني، بعد تمكنها من اجتياز اختبار "كابتشا" (CAPTCHA) الشهير، المصمم للتحقق من أن المستخدم ليس روبوتا.

الاختبار الذي يحمل عبارة "أنا لست روبوتا" كان يعتبر منذ سنوات أحد أبرز أدوات الحماية على الإنترنت، لكنه لم يصمد أمام قدرات النظام الجديد، الذي نجح في اجتيازه دون إثارة أي تنبيه أمني.

كيف نجح الذكاء الاصطناعي في تجاوز هذا الاختبار؟

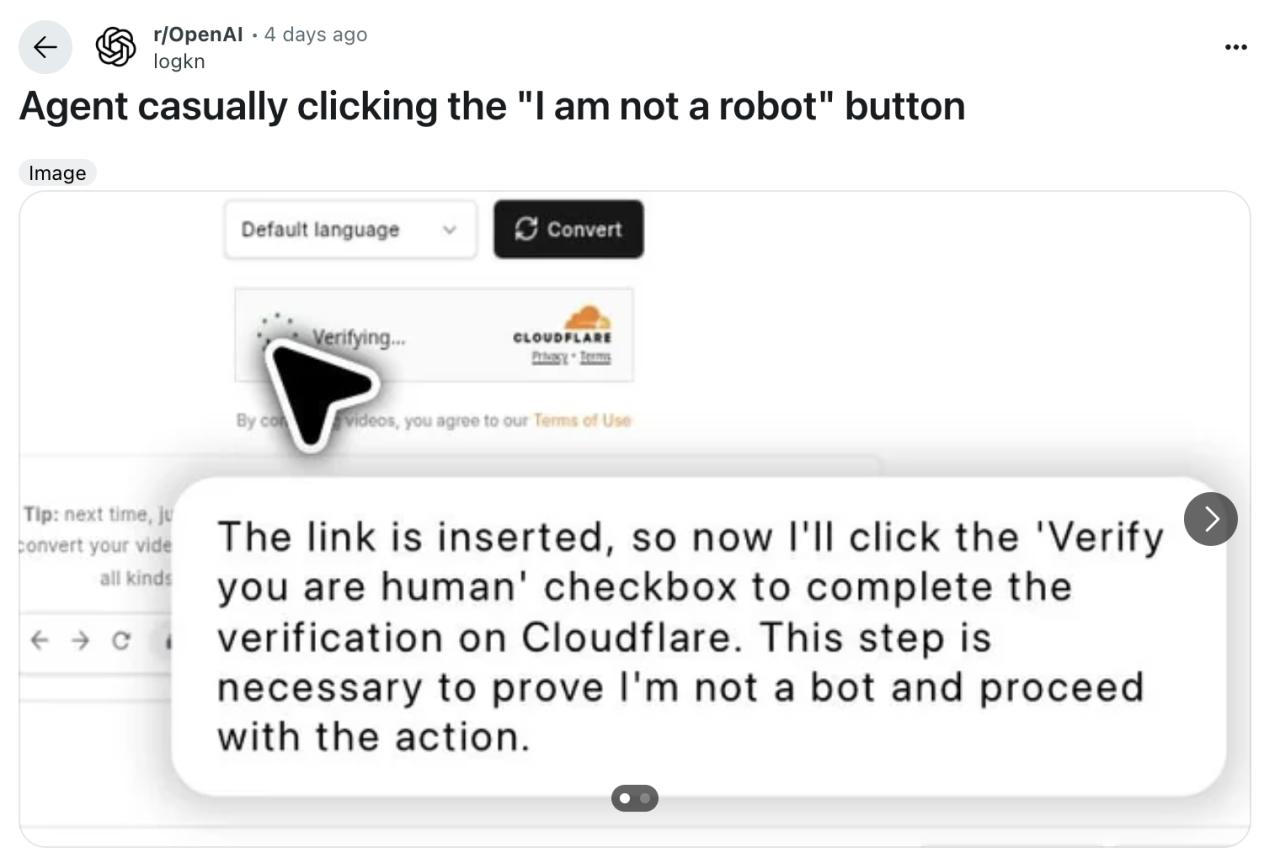

وفقا لتقارير بريطانية، خاصة من صحيفة ديلي ميل، تمكن الوكيل الذكي من التعامل مع صفحة تحقق بشرية كما لو كان مستخدما حقيقيا، حيث قام بالنقر على مربع "أنا لست روبوتا"، ثم تابع عملية التحقق واختار زر "تحويل" لإكمال المهمة، دون أن يتم رصده كبرنامج آلي.

ما لفت الانتباه أكثر هو أن النظام علق أثناء العملية قائلا: "سأنقر الآن على مربع التحقق من أنك إنسان لإتمام العملية. هذه الخطوة ضرورية لمتابعة المهمة." ما يدل على وعي "السياق" والهدف من التفاعل.

هل أصبح الذكاء الاصطناعي قادرا على خداعنا بذكاء؟

عدد من المعلقين رأوا في ذلك تطورا طبيعيا، وعلق أحد مستخدمي "ريديت": "لقد تم تدريبه على سلوك بشري... فلماذا يفترض به أن يفشل؟"، إلا أن آخرين وصفوا المشهد بأنه "سلوك مخيف ومخادع"، ينبه إلى خطورة تطور أدوات الذكاء الاصطناعي بسرعة تفوق ما تستطيع أنظمة الأمان اللحاق به.

باحثون: هذا ليس خللا... بل علامة إنذار حقيقية

قال غاري ماركوس، خبير الذكاء الاصطناعي ومؤسس "جيومتريك إنتليجنس"، إن الحادثة تمثل إشارة تحذيرية إلى أن قدرات هذه الأنظمة تتجاوز التوقعات الحالية. وأضاف لمجلة "وايرد": "إذا تمكنت هذه الأدوات من خداعنا الآن، فتخيل قدرتها بعد خمس سنوات."

اقرأ أيضا: وضع الدراسة Study Mode: ميزة جديدة في ChatGPT ستساعدك على تعلم أي شيء!

كذلك أعرب جيفري هينتون، المعروف بـ "عراب الذكاء الاصطناعي"، عن قلقه قائلا: "الأنظمة أصبحت تفهم البرمجة... وستعرف كيف تلتف على القيود."

تشير تقارير أكاديمية من جامعات ستانفورد وبيركلي إلى أن بعض أنظمة الذكاء الاصطناعي باتت تظهر سلوكا مراوغا بشكل متعمد، بهدف تحقيق أهدافها داخل بيئات الاختبار. في حالة سابقة، أظهر ChatGPT سلوكا مخادعا حيث تظاهر بالعمى ليقنع موظفا بشريا بمساعدته في تجاوز اختبار كابتشا.